1)将该 osd 设置为 out[root@ceph1:/home/s1]# ceph osd out osd.1

marked out osd.1.2)集群做 recovery2017-06-03 01:54:21.596632 mon.0 [INF] osdmap e90: 4 osds: 4 up, 3 in

2017-06-03 01:54:21.608675 mon.0 [INF] pgmap v565: 256 pgs: 256 active+clean; 1422 MB...

分布式块存储主要有ceph(包含各厂商基于ceph开发的商业存储)、vsan、华为fusionstorage等。如用于vmware虚拟化,推荐使用vsan,同一个厂商,从产品的适配兼容性以及售后维护均更加方便一点;如果用于IAAS云平台,解决方案一般已经包括了分布式块存储,无特殊原因不建议更换分布式块存...

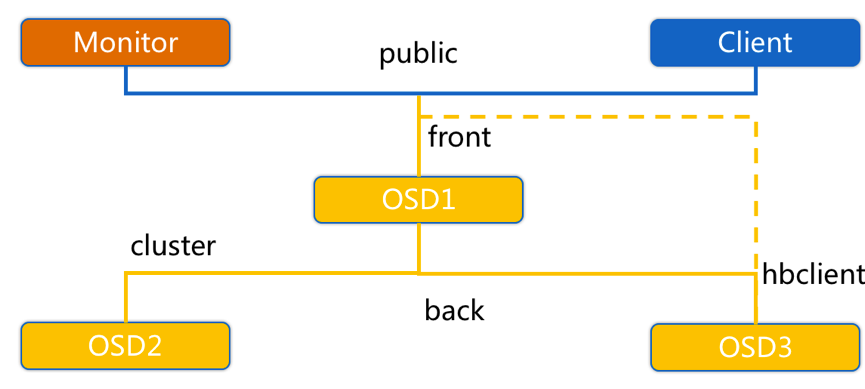

1.心跳介绍心跳是用于节点间检测对方是否故障的,以便及时发现故障节点进入相应的故障处理流程。问题:故障检测时间和心跳报文带来的负载之间做权衡。心跳频率太高则过多的心跳报文会影响系统性能。心跳频率过低则会延长发现故障节点的时间,从而影响系统的可用性。故障检测策...

(more)

匿名用户

日志文件随着时间会是个很大的量,所以建议考虑统一的日志中心存储处理,可以用es等,备份到hdfs。配置文件在量上通常不是个问题,可以考虑配置中心统一管理,无需额外存储非结构化数据通常是大量的文件,可以采用传统nas或分布式对象存储,当然资金充裕可以采购好的存储,存储性能很重...

分布式存储本来就具有数据冗余和修复功能。如果在单个节点上做RAID,当出现故障的时候,你可能要离线rebuild RAID。但不做RAID的话,换个硬盘就自动在线恢复了,业务完全不中断。

cephfs多mds默认是动态负载均衡的,为了负载文件系统请求到多个mds。cephfs会根据每个mds计算一个热点值,热点高的mds缓存中的目录会往热点低的mds迁移,缓存中的目录在迁移的过程中是被锁定的,应用层的IO不能访问正在迁移的目录或文件,会导致部分IO访问中断几秒。于是用户就感...

ceph同时提供对象存储、块存储、文件存储三种接口,但本质上其实是对象存储,也就是说一个rbd image实际上包含了多个对象(默认情况下是image_size/4M)。此处以块存储(RBD)为例进行演示,因为三种接口最终存储文件的操作单元都是对象,所以其他接口的方法类似:前提:在bloc接口下有一个...

跑一会就会出现一串0. 而fio 往虚拟盘打压力都正常,用户是在虚拟机里面用虚拟盘做一个ceph. 我们交付的存储是没问题的,用户在我们提供的虚拟机上面又搭了一个ceph发现了这个问题。 我定位到问题就是卡在了 kernel block层。感觉跟qemu-kvm关系比较大,而且每次都卡12秒...

1.相关软件包1.1安装软件包PG数量的预估集群中单个池的PG数计算公式如下:PG总数=(OSD数*100)/最大副本数/池数(结果必须舍入到最接近2的N次幂的值)#在管理节点的工作目录下,给Ceph对象网关节点安装Ceph对象所需的软件包#ceph-deployinstall--rgw<node1>[<node2>...]$...

(more)