MQ 6.0.2.5 实施文档

MQ 6.0.2.5

实施文档

目录

2.3 、 Enter WWN/License ID . 9

2.4 、 Write the feature activation key . 9

2.5 、 Enable the license feature . 9

4.2.1 、 安装 TSM Server 5.5.0.0 . 20

4.2.1.2 、 安装 TSM 服务器许可证 ... 22

4.2.2 、 升级 TSM Server 5.5.0.0 至 5.5.2.0 . 22

4.2.3 、 升级 TSM Server 5.5.2.0 至 5.5.2.1 . 23

4.3.1 、 安装 client 5.5.0.0 . 23

4.3.2 、 升级 client 5.5.0.0 至 5.5.2.0 . 24

4.3.3 、 升级 client 5.5.2.0 至 5.5.2.1 . 24

4.4.1 、 安装 Storage Agent 5.5.0.0 . 25

4.4.2 、 升级 Storage Agent 5.5.0.0 至 5.5.2.0 . 26

4.4.3 、 安装 Storage Agent 5.5.2.0 至 5.5.2.1 . 27

4.6.1 、 GUI 方式初始化 TSM Server . 28

4.6.2 、 command 方式配置 TSM Server . 30

4.6.3 、 定义 数据库卷和日志卷及其镜像、触发 ... 31

4.6.3.1 、 定义 db 卷和 log 卷的镜像 ... 31

4.6.3.2 、 定义扩展 db 和 log 的触发(已在 tsm 5.5.2.1 版本中体现) ... 31

4.6.7.1 、 tsm server 数据库备份 ... 32

4.6.7.2 、 tsm server 重要文件备份 ... 33

4.6.7.3 、 tsm server 卷历史信息删除 ... 33

4.6.7.4 、 tsm server 卷空间回收操作 ... 33

4.6.9 、 定义备份 oracle 和 file 的策略域 ... 33

4.6.10 、 定义备份 oracle 和 file 的策略集 ... 33

4.6.11 、 定义备份 oracle 和 file 的管理类 ... 33

4.6.12 、 定义备份 oracle 和 file 的副本组 ... 34

4.6.13 、 分配备份 oracle 和 file 的默认管理类 ... 34

4.6.14 、 激活备份 oracle 和 file 的策略集 ... 34

5.1 、 GUI 初始化客户机节点(以 ynwl01 为例) ... 35

5.1.1 、 确保 ynwl01_file 节点已被注册 ... 35

5.1.3 、 更改选项及配置文件 dsm.opt . 39

6.2.1 、 更改 dsmsta.opt 文件 ... 40

6.2.2 、 在 TSM Server 中定义 Storage Agent 服务器 ... 41

6.2.3 、 Client 上设置 Storage Agent Server 信息 ... 41

6.2.4 、 定义 Storage Agent 服务器的磁带机路径 ... 41

6.2.5 、 配置 Storage Agent 服务自动启动 ... 42

9.1 、 定义 file 类型设备类 / 存储池 / 卷 ... 61

9.2 、 更新 copygroup 的 destination . 61

10.2 、 TSM Server 管理常用操作 ... 64

## 第1章 环境准备

1.1、 介质描述

| Media | Level | Location |

| MQ Server For Linux(x86) | 6.0.0.0 | /mqsoft/mq6.0.0.0/ |

| MQ Server For Linux(x86) | 6.0.2.0 | /mqsoft/mq6.0.2.0/6.0-WS-MQ-LinuxIA32-RP0002.tar.gz |

| MQ Server For Linux(x86) | 6.0.2.5 | /mqsoft/mq6.0.2.5/6.0.2-WS-MQ-LinuxIA32-FP0005.tar.gz |

| MQ Server For AIX | 6.0.0.0 | /tmp/mqsoft/mq6.0.0.0/ |

| MQ Server For AIX | 6.0.2.0 | /tmp/mqsoft/mq6.0.2.0/6.0-WS-MQ-AixPPC64-RP0002.tar.Z |

| MQ Server For AIX | 6.0.2.5 | /tmp/mqsoft/mq6.0.2.5/6.0.2-WS-MQ-AixPPC64-FP0005.tar.Z |

1.2、 服务器及客户端信息

| Hostname | Platform | IP Information | Role | QManager Name |

| Red Hat Enterprise Linux AS release 4 (Nahant Update 7) | MQ Server | TDCS_MQM | ||

| Red Hat Enterprise Linux AS release 4 (Nahant Update 7) | MQ Server | TDCS_MQM | ||

| AIX | MQ Server | TDCS_MQM | ||

| AIX | MQ Server | TDCS_MQM |

/etc/fstab 文件中添加以下一行,以自动加载光驱

/dev/hda /media/cdrecorder auto pamconsole,exec,noauto,managed 0 0

scp /mqsoft/mq6.0.2.0/ 6.0-WS-MQ-LinuxIA32-RP0002.tar.gz root@192.168.1.9:/mqsoft/mq6.0.2.0/

scp /mqsoft/mq6.0.2.5/6.0.2-WS-MQ-LinuxIA32-FP0005.tar.gz root@192.168.1.9:/mqsoft/mq6.0.2.5/

第2章 安装配置 MQ Server FOR Linux

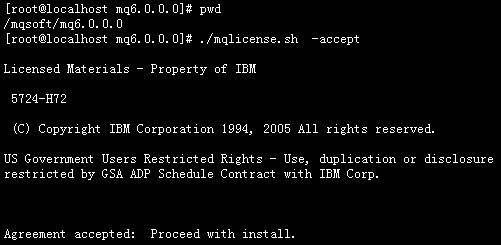

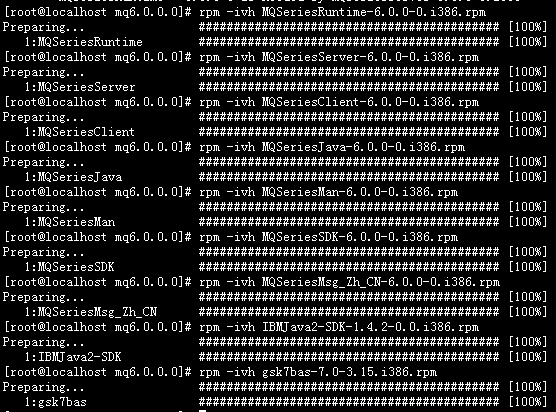

2.1、 安装 MQ Server 6.0.0.0

2.1.1、 创建用户组和用户

- 创建用户组

groupadd mqm -g 600

- 创建用户

useradd mqm -g mqm -u 600 -d /var/mqm

新建用户指定用户属于 mqm 组用户 uid 为 500 用户目录为 /var/mqm

2.1.2、 安装 MQ Server 6.0.0 .0

2.2、 升级 MQ Server 6.0.0 .0 至 MQ Server 6.0.2.0

2.2.1、 补丁下载

到以下链接

下载

WebSphere MQ V6 Linux on x86 platform Refresh Pack 6.0.2.0

6.0-WS-MQ-LinuxIA32-RP0002.tar.gz (355MB)

2.2.2、 解开补丁

cd /mqsoft/6.0.2.0

gzip -dc 6.0-WS-MQ-LinuxIA32-RP0002.tar.gz|tar -xvf –

2.2.3、 组件升级

cd /mqsoft/6.0.2.0

rpm -ivh MQSeriesRuntime-U806639-6.0.2-0.i386.rpm

rpm -ivh MQSeriesServer-U806639-6.0.2-0.i386.rpm

rpm -ivh MQSeriesClient-U806639-6.0.2-0.i386.rpm

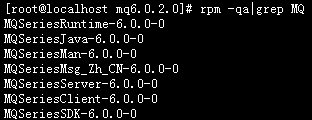

2.2.4、 版本验证

2.3、 升级 MQ Server 6.0.2.0 至 MQ Server 6.0.2.5

2.3.1、 补丁下载

到以下链接

下载

WebSphere MQ V6 Linux on x86 platform Fix Pack 6.0.2.5

6.0.2-WS-MQ-LinuxIA32-FP0005.tar.gz (360MB)

2.3.2、 解开补丁

cd /mqsoft/6.0.2.5

gzip -dc 6.0.2-WS-MQ-LinuxIA32-FP0005.tar.gz|tar -xvf –

2.3.3、 组件升级

rpm -ivh MQSeriesRuntime-U815767-6.0.2-5.i386.rpm

rpm -ivh MQSeriesServer-U815767-6.0.2-5.i386.rpm

rpm -ivh MQSeriesClient-U815767-6.0.2-5.i386.rpm

2.3.4、 版本验证

2.4、 配置 MQ Server FOR LINUX

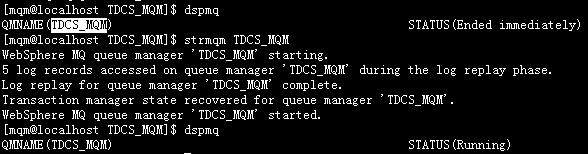

2.4.1、 创建队列管理器 TDCS_MQM

su -mqm

crtmqm -lp 40 -ls 10 -lf 16384 TDCS_MQM

2.4.2、 更改配置文件

- 更改文件 /var/mqm/qmgrs/TDCS_MQM/qm.ini

添加如下内容 :

CHANNELS:

MaxChannels=2000

MaxActiveChannels=2000

TCP:

KeepAlive=YES

TunningParameters:

AgentClassMap=(1,1,2)

AgentClassLimit1=(48,64,42)

__

- 更改文件 /etc/services

添加如下内容 :

mq 1414/tcp #mq services

__

2.4.3、 启动队列管理器 TDCS_MQM

2.4.4、 配置队列管理器 TDCS_MQM

请参考以下脚本,并根据自身的需求来配置队列管理器

runmqsc QM_EAI << !

define channel(QM_EAI.CHL.SVRCONN) chltype(SVRCONN) trptype(TCP) mcauser('mqm')

define listener(QM_EAI) trptype(TCP) port(10999) control(QMGR)

__

define channel(TO.QM_EAI_A) chltype(CLUSSDR) trptype(TCP) CONNAME('188.188.8.116(10999)') CLUSTER(DLYH)

define channel(TO.QM_EAI) chltype(CLUSRCVR) trptype(TCP) CONNAME('188.188.8.118(10999)') CLUSTER(DLYH)

__

define qlocal(LOCALQ.QM_EAI.103_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.124_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.202_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.203_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.222_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.401_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.511_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.512_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.MONITOR.999) CLUSTER(DLYH)

define qlocal(QUEUE_OUT) CLUSTER(DLYH)

!

2.4.5、 队列管理器启动与停止脚本

/var/mqm/scripts/mq_start.sh

su - mqm -c "strmqm TDCS_MQM"

su - mqm -c "nohup runmqlsr -t tcp -p 1414 -m TDCS_MQM &"

__

/var/mqm/scripts/mq_stop.sh

su - mqm -c "endmqm -i TDCS_MQM" & 2>1&

su - mqm -c "endmqlsr -m TDCS_MQM" & 2>1&

sleep 60

__

ps -fu mqm|awk '{print $2}'|xargs -i kill -9 {}

sleep 2

ps -fu mqm|awk '{print $2}'|xargs -i kill -9 {}

sleep 2

ps -fu mqm|awk '{print $2}'|xargs -i kill -9 {}

sleep 2

__

ipcs -m| grep mqm | awk '{print $2}' | xargs -i ipcrm -m {}

sleep 2

ipcs -q| grep mqm | awk '{print $2}' | xargs -i ipcrm -q {}

sleep 2

ipcs -s| grep mqm | awk '{print $2}' | xargs -i ipcrm -s {}

sleep 2

ipcs -m| grep mqm | awk '{print $2}' | xargs -i ipcrm -m {}

sleep 2

ipcs -q| grep mqm | awk '{print $2}' | xargs -i ipcrm -q {}

sleep 2

ipcs -s| grep mqm | awk '{print $2}' | xargs -i ipcrm -s {}

sleep 2

__

2.4.6、 队列管理器发送与接收消息测试

在消息“发送方” 192.168.1.9 上执行 MQSC 命令:

| su – mqm crtmqm test9 strmqm test9 runmqsc test9 传输队列 def ql(test9) usage(xmitq) 修改触发 alter ql(test9) trigdata(8.9.CH) 建立远程队列本地定义 def ql(MES.test9.REC) trigger trigtype(first) initq(test9.INIT1.QUEUE) process(REC_MES) defpsist(yes) 建立本地队列 def qr(test8.Q.1) rqmname(test8.QM) rname(test8.Q.1) xmitq(test8.QM) 建立发送通道 def chl(8.9.CH) chltype(SDR) conname('192.168.1.9 (1414)') xmitq(test9.QM) trptype(tcp) 建立接收通道 define channel(9.8.CH) chltype(rcvr) trptype(tcp) 定义端口 vi /etc/services----------添加test 1414/tcp vi /etc/inetd.conf--------添加test stream tcp nowait mqm /usr/mqm/bin/amqcrsta amqcrsta –m test9 |

__

在消息“接收方” 192.168.1.8 上执行 MQSC 命令:

| su – mqm crtmqm test8 strmqm test8 runmqsc test8 传输队列 def ql(test8) usage(xmitq) 修改触发 alter ql(test8) trigdata(9.8.CH) 建立远程队列本地定义 def qr(test8.Q.1) rqmname(test8.QM) rname(test8.Q.1) xmitq(test8.QM) 建立本地队列 def ql(MES.test9.REC) trigger trigtype(first) initq(test9.INIT1.QUEUE) process(REC_MES) defpsist(yes) (本地应答队列):def ql(test9.R) 建立发送通道 def chl(9.8.CH) chltype(SDR) conname('192.168.1.8 (1414)') xmitq(test8.QM) trptype(tcp) 建立接收通道 define channel(8.9.CH) chltype(rcvr) trptype(tcp) 定义端口 vi /etc/services----------添加hp 1414/tcp vi /etc/inetd.conf--------添加hp stream tcp nowait mqm /usr/mqm/bin/amqcrsta amqcrsta –m test8 refresh -s inetd |

__

第3章 安装配置 MQ Server FOR AIX ( HACMP )

3.1、 安装 MQ Server 6.0.0.0

3.1.1、 创建目录

varyonvg mqvg

mkdir /TDCS_MQM

mkdir /TDCS_MQM/data

mkdir /TDCS_MQM/log

3.1.2、 创建文件系统

mklv -y TDCS_MQM_datalv -t jfs2 mqvg 10G

mklv -y TDCS_MQM_loglv -t jfs2 mqvg 10G

crfs -v jfs2 -d /dev/TDCS_MQM_datalv -m /TDCS_MQM/data -A yes

crfs -v jfs2 -d /dev/TDCS_MQM_loglv -m /TDCS_MQM/log -A yes

mount /TDCS_MQM/data

mount /TDCS_MQM/log

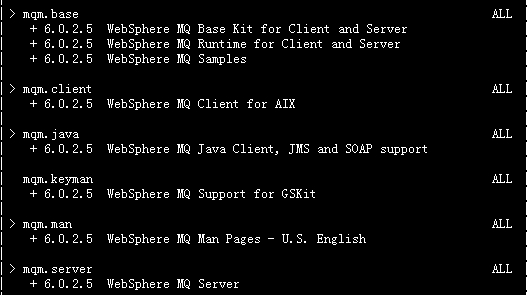

3.1.3、 安装

Mqm.base

Mqm.server

Mqm.client

Mqm.java

3.1.4、 更改属组、权限

chown -R mqm:mqm /TDCS_MQM/data

chown -R mqm:mqm /TDCS_MQM/log

chmod -R 777 /TDCS_MQM/data

chmod -R 777 /TDCS_MQM/log

3.1.5、 版本验证

3.2、 升级 MQ Server 6.0.0.0 至 MQ Server 6.0.2.0

3.2.1、 补丁下载

到以下链接

下载

WebSphere MQ V6.0 AIX Refresh Pack 6.0.2.0

6.0-WS-MQ-AixPPC64-RP0002.tar.Z (331MB)

3.2.2、 解压补丁

cd /tmp/mqsoft/mq6.0.2.0/

uncompress 6.0-WS-MQ-AixPPC64-RP0002.tar.Z

tar -xvf *.tar

3.2.3、 安装

3.2.4、 版本验证

3.3、 升级 MQ Server 6.0.2.0 至 MQ Server 6.0.2.5

3.3.1、 补丁下载

到以下链接

下载

WebSphere MQ V6.0 AIX Fix Pack 6.0.2.5

6.0.2-WS-MQ-AixPPC64-FP0005.tar.Z (354MB)

3.3.2、 解压补丁

cd /tmp/mqsoft/mq6.0.2.5/

uncompress 6.0.2-WS-MQ-AixPPC64-FP0005.tar.Z

tar -xvf *.tar

3.3.3、 安装

3.3.4、 版本验证

3.4、 配置队列管理器

3.4.1、 创建 QM

crtmqm -lp 40 -ls 10 -lf 16384 -ld '/TDCS_MQM/log' TDCS_MQM

3.4.2、 修改文件 /var/mqm/mqs.ini

修改 Queue manager 所在目录,进入 /var/mqm/

cp mqs.ini mqs.ini.bak

vi mqs.ini

找到 QueueManager:

Name=TDCS_MQM

Prefix=/var/mqm

将 prefix 的值改成 Queue Manager 将要放置的目录如 :

Prefix=/TDCS_MQM/data

修改好后保存退出

3.4.3、 拷贝 /var/mqm/qmgrs 至集群环境

将已经新建好的 Queue Manager 移动到指定目录下

cp -rf /var/mqm/qmgrs/ /TDCS_MQM/data

3.4.4、 修改 qm.ini

cp /TDCS_MQM/data/qmgrs/TDCS_MQM/qm.ini /TDCS_MQM/data/qmgrs/TDCS_MQM/qm.ini.bak

vi /TDCS_MQM/data/qmgrs/TDCS_MQM/qm.ini

添加如下内容 :

CHANNELS:

MaxChannels=2000

MaxActiveChannels=2000

TCP:

KeepAlive=YES

TunningParameters:

AgentClassMap=(1,1,2)

AgentClassLimit1=(48,64,42)

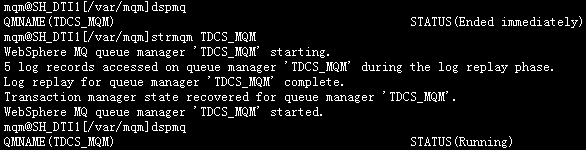

3.4.5、 启动 QM

su - mqm

3.4.6、 配置 QM

按照类似如下的脚本对队列管理器 TDCS_MQM 进行通道及队列的定义

runmqsc QM_EAI << !

define channel(QM_EAI.CHL.SVRCONN) chltype(SVRCONN) trptype(TCP) mcauser('mqm')

define listener(QM_EAI) trptype(TCP) port(10999) control(QMGR)

define channel(TO.QM_EAI_A) chltype(CLUSSDR) trptype(TCP) CONNAME('188.188.8.116(10999)') CLUSTER(DLYH)

define channel(TO.QM_EAI) chltype(CLUSRCVR) trptype(TCP) CONNAME('188.188.8.118(10999)') CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.103_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.124_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.202_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.203_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.222_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.401_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.511_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.512_TO_999.RESP) CLUSTER(DLYH)

define qlocal(LOCALQ.QM_EAI.MONITOR.999) CLUSTER(DLYH)

define qlocal(QUEUE_OUT) CLUSTER(DLYH)

3.5、 切换至备节点

3.5.1、 创建目录

主节点上

su - mqm

endmqm -i TDCS_MQM

exit

umount /TDCS_MQM/log

umount /TDCS_MQM/data

varyoffvg mqvg

备节点上

mkdir /TDCS_MQM

mkdir /TDCS_MQM/data

exportvg mqvg

importvg -V 45 -y mqvg hdisk3

mount /TDCS_MQM/data

mount /TDCS_MQM/log

3.5.2、 安装

Mqm.base

Mqm.server

Mqm.client

Mqm.java

3.5.3、 更改属组、权限

chown -R mqm:mqm /TDCS_MQM/data

chown -R mqm:mqm /TDCS_MQM/log

chmod -R 777 /TDCS_MQM/data

chmod -R 777 /TDCS_MQM/log

3.5.4、 更改 /var/mqm/mqs.ini 文件

QueueManager:

Name=TDCS_MQM

Prefix=/TDCS_MQM/data

Directory=TDCS_MQM

3.5.5、 备节点启动 QM

如果觉得我的文章对您有用,请点赞。您的支持将鼓励我继续创作!

赞2作者其他文章

评论 6 · 赞 9

评论 2 · 赞 4

评论 0 · 赞 4

评论 0 · 赞 2

评论 0 · 赞 4

添加新评论0 条评论