互联网服务Ceph

3同行回答

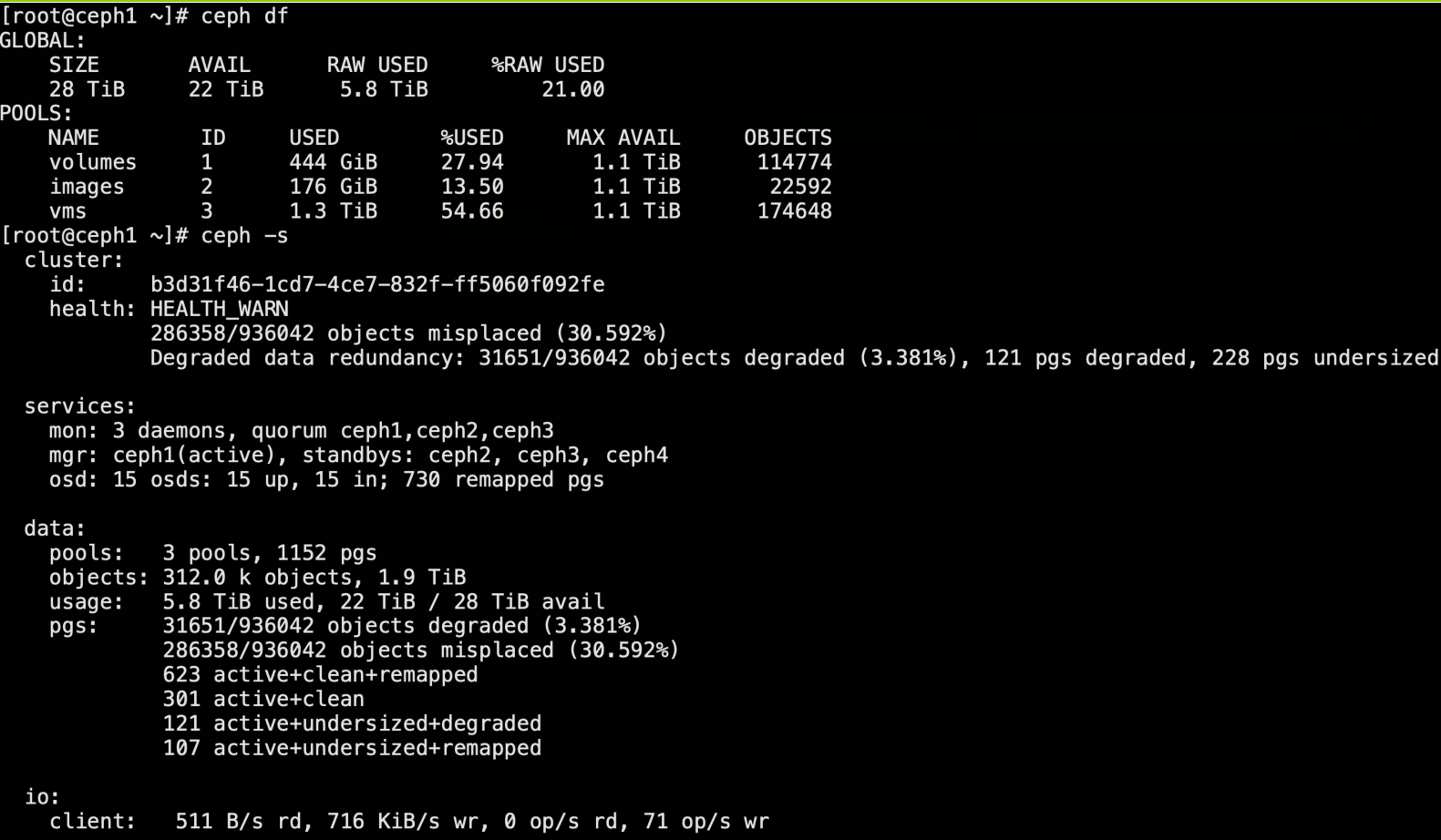

看输出中,pool 的配置信息,为什么3个pool 显示的 Max Avail 都是 1.1 TB 呢 ?3个pool加起来也就是 3.3TB ,3副本是 9.9TB ? 好像和实际的磁盘容量大小不符啊;

收起1. 尽量选择同一类型的机器,不同的类型最好要弄不同的分组,如果不这么干,计算起来很麻烦,包括后面程序分析出来的结果也会不准。

2. crush map特别要注意rule,如果rule里有两个不同的地域存储规则,那么采用这个规则的pool的最大可用size将由最小的地域size规定。所以,如果你有异地存储或者不同分组存储的时候,尽量像天平一样,保证两边平衡,这样才能最大限度的展现出存储能力。

3. 留意快照存储及存储副本数量

浏览1501