某大型商业银行Power云化实践

随着互联网金融的到来,数字化、智能化技术与开放银行已经逐渐成长为个大银行的重点发展方向。随着人民银行《金融科技( FinTech )发展规划( 2019-2021 年)》的发布,更为各家银行指明了一条以开源技术为基础的”云”计算必由之路。

根据“十三五”规划要求, 2017 年某大型商业银行(以下简称 C 行)开始实施云计算建设,基于虚拟化技术建立私有云,实现了资源池的一键式资源部署、规范交付资源。数据中心交付能力得到了大幅度提升,资源交付由原来以天为单位转变为分钟级。目前生产云平台已纳管 10 个资源池,存量纳管分区数量达 2000 余台。

其中 Power 服务器以其强悍的性能以及长期稳定可靠的表现,即便在当下 去 IOE 的大环境下,仍将 长期作为除大机以外的核心及关键系统的硬件承载平台。本文将基于 C 行验收测试环境 Power 云化建设的实践案例, 帮助大家 理解 Power 资源池和云化过程。

- Power LPAR 和虚拟化

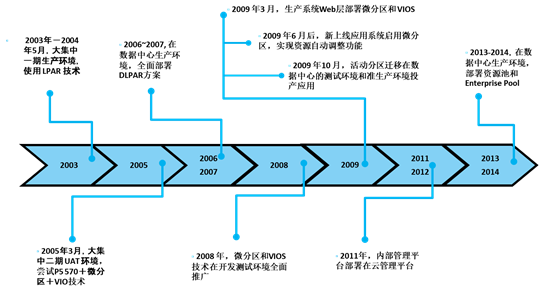

C 行是国内大型商业银行中较早引入并在上产环境中广泛使用 Power 虚拟化技术的。早在 2003 年的大集中一期生产环境中就广泛采用的 LPAR 逻辑分区技术,并在 2006 年在 System p5 上引入了 DLPAR 动态逻辑分区。与此同时,开发测试环境和验收测试环境从 2005 年开始尝试使用微分区( Micro-Partition )和虚拟 IO (VIO) 技术, 2008 年开始在开发测试环境实现全面推广,并在 2009 年进一步将微分区和虚拟 I/O 技术推广到生产环境中,并在之后的数年内引入了活动分区迁移等高级虚拟化功能,并结合 Enterprise Pool 功能构建了基于 Power7 和 Power8 服务器的 Power 资源池,因此 C 行在 Power 虚拟化上积累了丰富的经验,并根据自身情况制定了 Power 虚拟化部署规范。

- 云计算的初次尝试

在 2011 年 Openstack 还没有成为事实上的 IaaS 云标准, C 行已经开始了尝试云平台建设工作,当时在在在内部管理环境通过引入了 IBM TSAM 构建了 C 行的第一朵云。

随着新一代信息系统的建设完成, C 行分别在数据中心生产环境、开发测试及验证环境以及内部管理环境形成了 3 种不同的运维和管理模式 :

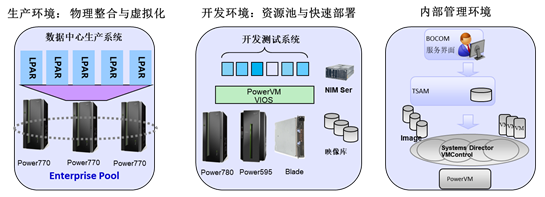

- 生产环境:广泛采用 DLPAR 方式部署,并通过 Enterprise Pool 实现服务器之间动态资源调度,在保证系统稳定运行的前提下,兼顾资源的灵活调度,以便应对突然的业务增长压力;

- 开发测试机验证环境:全部采用 PowerVM 微分区和虚拟 I/O 技术,实现更高的资源优化与集成,通过自动化脚本和 NIM 服务器实现分区标准化部署,降低管理复杂度和基础设施的成本、提高服务交付水平。

- 内部管理环境,通过 IBM TSAM 平台调用 System Director, 可实现 Power 服务器在单一系统管理界面统一管理,集成的自动化管理和智能分析功能,可根据工作负载优化环境,业务高可用与安全,动态的能源优化,应用自我服务和弹性扩充。

- 新一代云平台建设

2017 年,随着 C 行启动“下一代信息系统”的建设 ,为了应对未来互联网类应用潮汐式的特点和应用产品的快速开发迭代, C 行开始筹备新一代的云计算平台建设。经过多次内部调研,决定先期考虑将验收测试环境作为试点,以此作为探索整体上云的路径。

为了响应业务快速迭代的需求,应用开发部门将产品迭代周期从原来的一个季度一次缩短至一个月一次,但验收测试环境的搭建还是以传统手工方式为主,并且整个环境搭建工作涉及设备、网络、系统和应用多部门沟通协调,平均一个测试环境的搭建工作往往需要 5 天时间,使得一个本来只需要 3 天的验证测试工作周期被拉长到了至少一周时间,大大拖慢了新应用上线的时间。

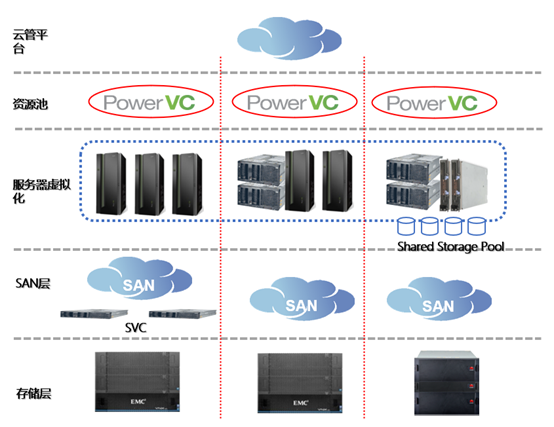

通过引入一家国内知名的云管平台,实现了不同硬件平台的统一管理,通过 vCenter 管理 x86 环境,通过 PowerVC 管理实现了 PowerVM 虚拟化的 Power 服务器,同时也将原有部分 Openstack 、 SCP 和 ACI 等异构软硬件平台做了统一纳管。当前验收测试环境的系统架构如下:

相对于 vCenter 在行内的广泛应用,对于 PowerVM 的管理方式相对比较传统,此前仍然是采用手工方式进行部署,通过 PowerVC 引入,大大提升了 Power 计算资源的部署效率。

PowerVC 是在 OpenStack 开放架构基础上打造的高级虚拟化管理产品,它针对 Power 服务器上的 AIX 、 IBM i 与 Linux 环境提供了高级虚拟化管理功能。除了针对 Power 系统的高级虚拟化管理、虚拟机捕获与快速部署、虚拟机在线迁移、基于策略的工作负载部署、工作负载优化及快速配置等虚拟化全生命周期管理功能以外, PowerVC 还添加了简化的用户界面、增强的企业级资源调度功能,以及可靠性和可服务性功能,使 PowerVC 成为 Power System 虚拟化环境最佳的管理平台,是打造基础架构云管理平台坚实高效的管理工具。

此外,PowerVC 提供了基于 OpenStack 的 REST API 接口,利用这些接口,客户在其 OA 系统或已有的管理平台上自行通过 API 轻松对接云管平台;

- PowerVC 存储兼容问题的解决

在决定将 PowerVC 引入 C 行后,面临最大的问题就是 PowerVC 对可纳管的存储品牌和型号有一定的要求,而 C 行验收测试环境的存储设备纷繁复杂,为了能够尽可能地利用这些存储资源, C 行在对验收测试环境的存储做了详细的梳理工作后,最终决定通过三种不同的方式完成 PowerVC 对所有存储设备的纳管:

- 针对 EMC VNX 型号, PowerVC 可以通过 NaviSphere CLI 直连的方式进行管理;

- 针对有条件改造成 SVC 纳管方式的存储,通过 SVC 统一管理存储资源;

- 针对其他 PowerVC 无法直接管理或通过 SVC 纳管的存储,通过 PowerVM 的 Shared Storage Pool ( SSP )方式实现纳管

在整个云方案里, PowerVC 作为 Power 服务器资源的虚拟化管理平台,起到了承上启下的作用,底下对接计算资源、存储资源和网络资源;对上通过 Restful API 接入云管平台。在解决了存储接入问题后, C 行对于 PowerVC 进行了大量的测试工作,经过一个多月的测试验证工作,总共 6 大类 40 个测试项目全部通过:

- 通过 CMP 云管平台进一步实现流程化自动化部署

在通过 CMP 云管平台实现了异构环境统一管理的基础上,实现了

1) Power 和 x86 环境的混合编排, ACI 与 vCenter 、 PowerVC 的静态集成,实现基于应用视图的跨云多分区自动化部署,并通过资源分配和参数配置的标准化,形成资源分配模型,实现端到端自动化交付。

2)实现高度自动化的资源全生命周期管理, 对 资源进行自动化上下线等操作,提升运维效率 。

3)对接外部管理平台,完成 对接 C 行现有的 IT 工作平台、 CMDB 等; 完成流程化改造, 实现了基于端到端的自动化交付,在云管平台上配置并简化审批流程。

最终 C 行在完成验证测试环境的多云管理平台打造后,有效实现验证测试环境 VMware 、 OpenStack 和 Power 资源的统一管理,虚拟机数量达 5000+ ;整合 Cisco SDN 、 F5 负载均衡和 EMC 存储,打造集计算、网络和存储于一体的管理平台;一套应用环境交付周期从 5 天缩短至 1 小时;继承 C 行多套 ITSM 和 CMDB ,提升业务数据同步的实时性。

- 写在最后:云平台建设效果与价值收益

1 )交付效率大大提高:通过云平台的成功建设,大大提高了验收测试平台的交付效率,平均交付时间由原先的 5-7 天缩短到了 1-2 个小时;简化了部署流程,部署过程无需网络组,存储组的人工参与。

2 )资源部署标准化:在云平台建设过程中,先后梳理落地了近 100 条部署规范,包含计算、存储、网络、操作系统、数据库和中间件,保证业务分区或应用环境的自动化推送符合 C 行规范,实现了零出错。

3 )为生产上云奠定了基础:云平台在验收测试环境成功落地后,极大地提振了 C 行生产环境上云的信息,加速了推进生产上云的进程

如果觉得我的文章对您有用,请点赞。您的支持将鼓励我继续创作!

赞3作者其他文章

评论 0 · 赞 1

评论 0 · 赞 1

评论 7 · 赞 13

评论 4 · 赞 4

评论 1 · 赞 2

添加新评论0 条评论