4同行回答

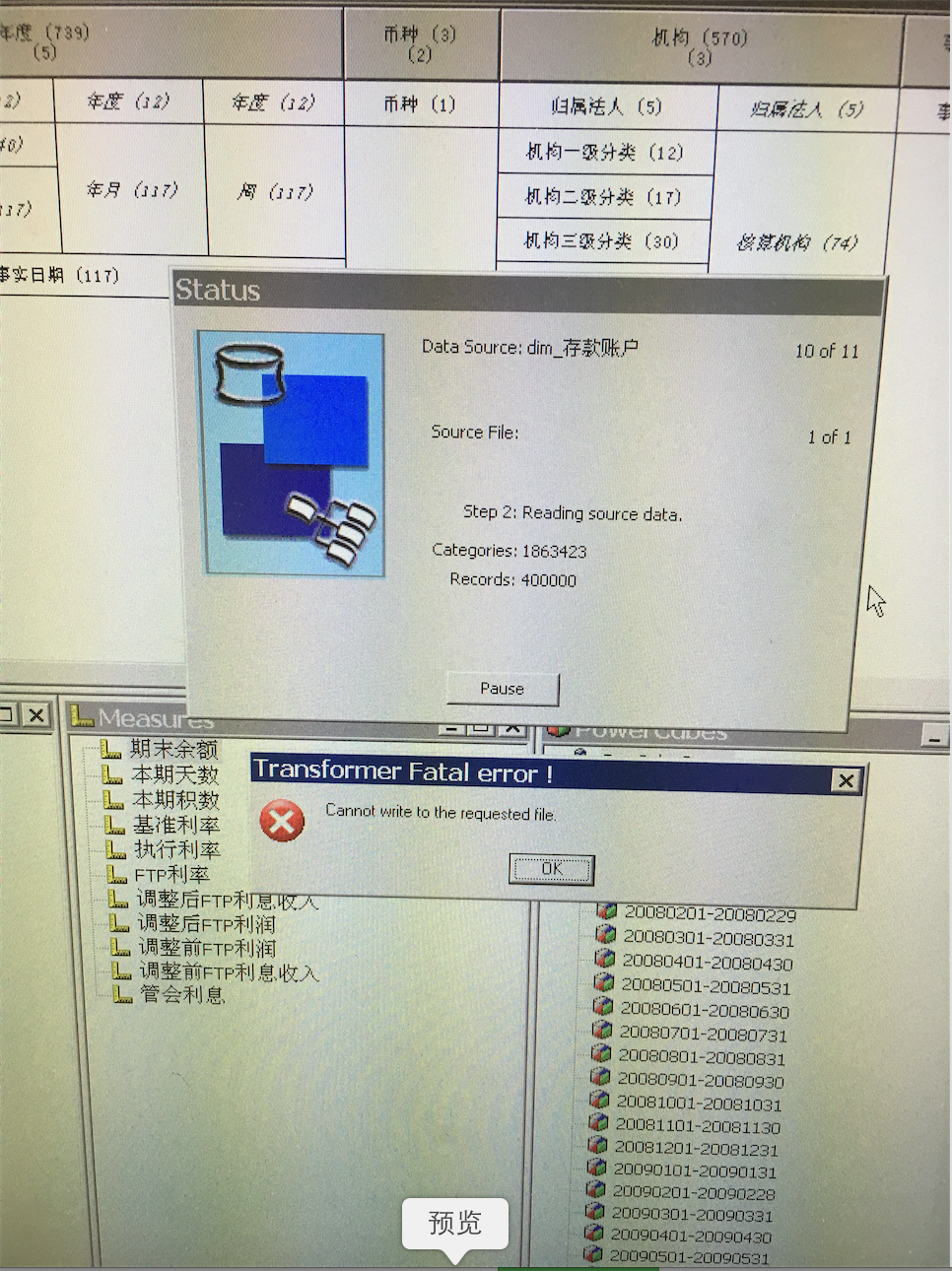

这么大的数据量那,powercube有一个弊端就是 cube文件最多只能2G,如果超过就会报错,这个是硬伤,所以cube数据多的时候 得考虑如何处理这么大的数据量。

另外,你的cognos的版本是多少?

是有现在,可以改配置文件,让生成的cube大些。

应该8.4最大4个g,其实再大没什么意义,这个大的单个磁盘文件,访问效率也低。

看你的截图,cube已经进行分组了,应该生成的每个cube文件不很大才对。几百兆正常,不应该卡死。

是每次都卡死,还是以前正常,现在卡死?

日期维度怎么那么复杂?另外维表数据不应该那么大,应该是粗粒度结果,否则所有维度差乘结果很吓人,而去这张粒度对cube没什么意义,也没必要用cube的模式

收起